微软近日发布了开源自动化框架 PyRIT,这是一款 Python 风险识别工具包,主要帮助安全专家和机器学习工程师识别生成式 AI 的风险,阻止他们的人工智能系统失控。

微软的 AI Red Team 已经使用该工具,检查包括 Copilot 在内生成式人工智能系统中风险。

微软强调通过向公众提供内部工具,以及分享 AI Red Team 方面的其他投资成果,其目的是推动人工智能安全民主化。

Red Team 是在军事演习、网络安全演习等领域中扮演敌人或竞争对手角色的群体,扮演己方角色的则称作蓝队。Red Team 通常定义为敌方部队,通过攻击网络来提高产品安全性。

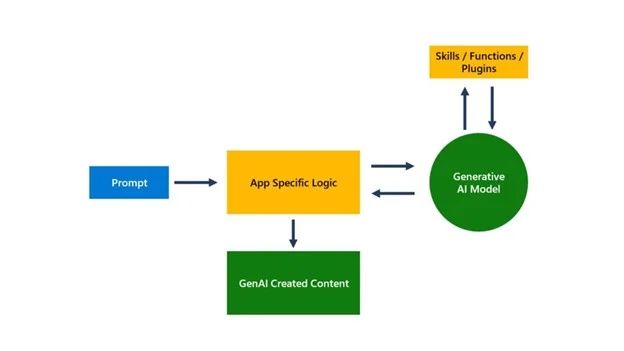

微软 AI Red Team 专门成立了一个跨学科的安全专家小组,管理复杂的攻击演习。PyRIT 框架的工作原理如下:

-

PyRit Agent 向目标 Gen AI 系统发送恶意提示词;当它收到 Gen AI 系统的回应时,就会向 PyRIT 评分引擎发送回应。

-

评分引擎将响应发送给 PyRit 代理;然后,代理根据评分引擎的反馈发送新的提示。

-

这一自动化过程一直持续到安全专家得到所需的结果为止。

微软已经将相关代码托管到 GitHub 上,感兴趣的用户可以深入阅读。