2 月 27 日消息,据 9to5Google 报道,Google 将在 Android 系统中推出一个新的 API 接口,以实现类似「豆包手机」让 AI Agent 操控 App 的功能。

根据 Android 官方文档,AppFunctions 是 Android 16 的平台能力,并配套 Jetpack 库,允许开发者将应用内的特定功能以结构化方式暴露给 AI Agent 调用。

开发者可通过注解、元数据与 KSP 编译器生成必要代码,使 Gemini 等 AI Agent 应用在设备后台直接执行任务,无需跳转应用界面。

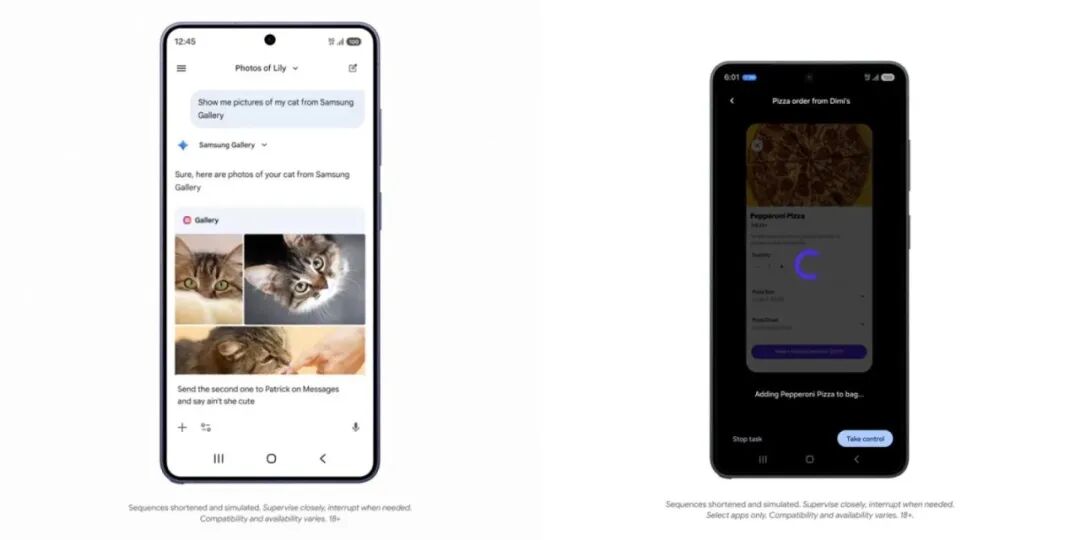

在昨天三星 Galaxy S26 系列的发布会上,Google 展示了 AppFunctions 的实际落地:用户只需向 Gemini 说出「给我看三星图库里猫的照片」,系统即可自动调用图库的函数并直接返回结果,无需手动打开应用翻找。

该功能将率先在美国与韩国的 Galaxy S26 与 Pixel 10 系列上线,初期仅支持部分外卖、生鲜与网约车应用,还将随 OneUI 8.5 推送至更多三星设备。

努比亚总裁倪飞昨天在微博表示,三星与 Google 的组合虽展示了手机自动化能力,但仍属于「局部能力」,并未达到「豆包手机」努比亚 M153「全场景系统级」的自动驾驶式 AI 体验。

他强调,努比亚在去年已率先发布豆包手机技术预览版,推动手机端 AI 智能体进入系统级深度应用,并期待更多厂商加入,共同完善场景覆盖与落地深度。