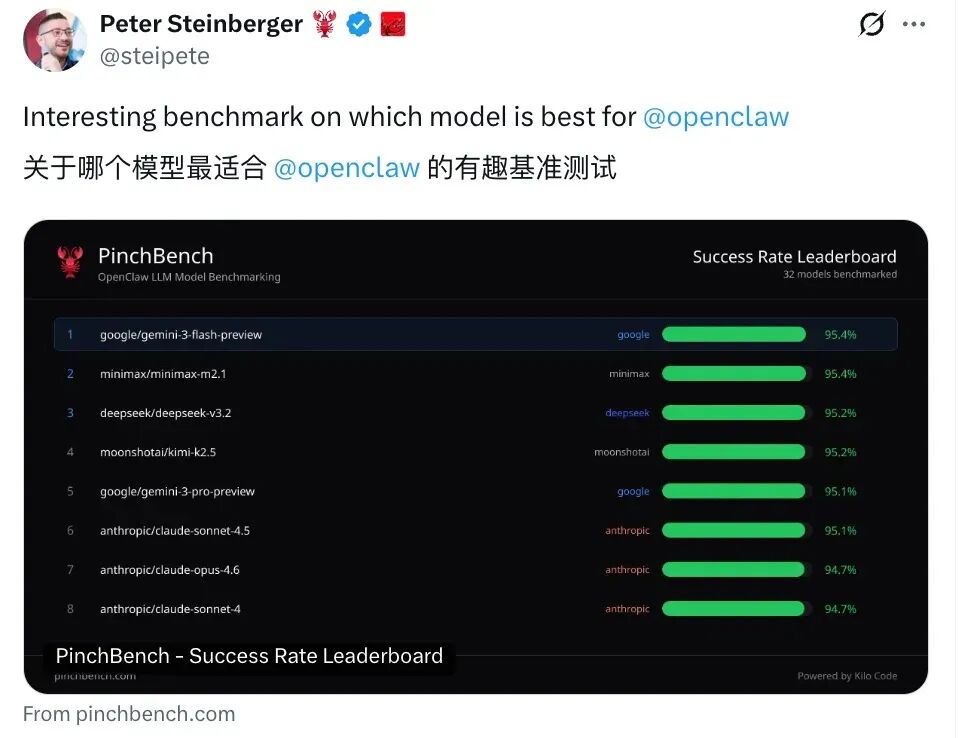

3 月 9 日消息,昨天,专为评估大语言模型在 OpenClaw 任务中表现的基准测试 PinchBench 正式出炉,一次性测试了 32 款主流大模型,从成功率、速度与成本三个维度进行横向比较。

在成功率维度,Google 的 Gemini 3 Flash Preview 以 95.1% 的成功率位居第一。

作为 Gemini 系列的「轻量版」,其表现超越了自家旗舰 Gemini 3 Pro(91.7%),也压过了 Claude Sonnet 4.5(92.7%)与 GPT-4o(85.2%)。

国产模型表现同样亮眼,MiniMax M2.1 以 93.6% 的成功率排名第二,Kimi K2.5 以 93.4% 紧随其后,两款国产模型共同占据全球前三中的两席。

Anthropic 旗舰模型 Claude Opus 4.6 成功率仅为 90.6%,排名第七,落后于多款中端模型。

速度方面,MiniMax M2.5 以 105.96 秒完成全部测试任务,以 0.09 秒的微弱优势领先第二名 Gemini 2.0 Flash,夺得速度冠军。

相比之下,Claude Sonnet 4 耗时 137.66 秒,Gemini 3 Pro 则高达 239.55 秒,约为冠军用时的两倍。

成本维度上,GPT-5 Nano 以每次任务 0.03 美元成为全场最低价选项,成功率为 85.8%。

Gemini 2.5 Flash Lite 以 0.05 美元、83.2% 的成功率紧随其后。而 Claude Opus 4.6 完成测试的成本高达 5.89 美元,是 GPT-5 Nano 的近 200 倍,但成功率反而低于 MiniMax M2.1 逾 3 个百分点。

PinchBench 的评分机制包括代码运行验证(自动化检查)、质量评估(由 Claude Opus 担任评委)以及两者结合三种方式,所有题目与答案均已开源至 GitHub。完整榜单可在 pinchbench.com 查阅。