3 月 19 日消息,昨天,月之暗面 Kimi 创始人杨植麟在英伟达 GTC 2026 大会上发表主题演讲《How We Scaled Kimi K2.5》,首次系统性披露了 Kimi 的完整技术路线图,围绕三项底层架构重构展开:

MuonClip 优化器:针对沿用自 2014 年的 Adam 优化器,团队在 Muon 优化器基础上引入 Newton-Schulz 迭代与 QK-Clip 机制,解决了万亿参数规模训练中的 Logits 爆炸问题,实现了 2 倍于传统 AdamW 的计算效率;

Kimi Linear:基于 KDA 架构的混合线性注意力架构,挑战「所有层必须使用全注意力」的惯例,在 128K 乃至 1M 超长上下文场景中,将解码速度提升 5 到 6 倍;

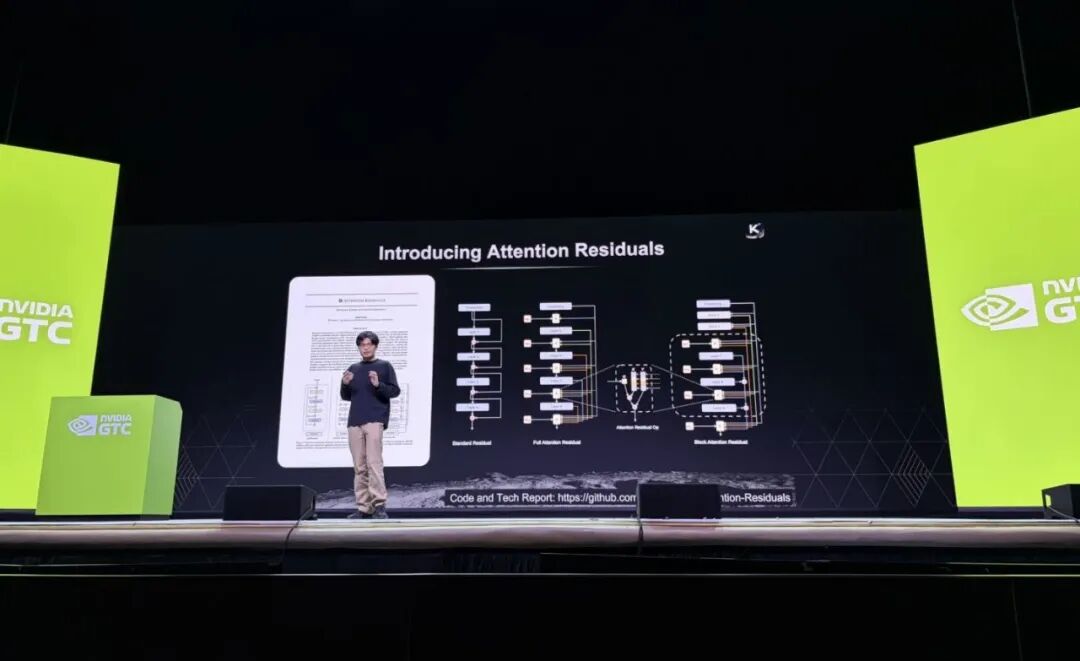

AttentionResiduals:针对沿用十年的残差连接,将传统的等权叠加替换为跨层的 Softmax 注意力,让每一层主动、有选择性地从前序层提取信息。

其中,Attention Residuals 发布后在业界引发广泛关注:马斯克评论称「令人印象深刻」,前 OpenAI 联合创始人 Karpathy 感慨「看来我们还没把『Attention is All You Need』按字面意思理解透」,OpenAI o1 主要发明者 Jerry Tworek 称其为「深度学习 2.0」的开端。

杨植麟表示,Kimi 将坚持开源路径,把 MuonClip、Kimi Linear 和 Attention Residuals 等底层创新贡献给开源社区。