4 月 3 日消息,美团龙猫昨日发布音频生成模型 LongCat-AudioDiT,并同步开源 1B 和 3.5B 两个版本。

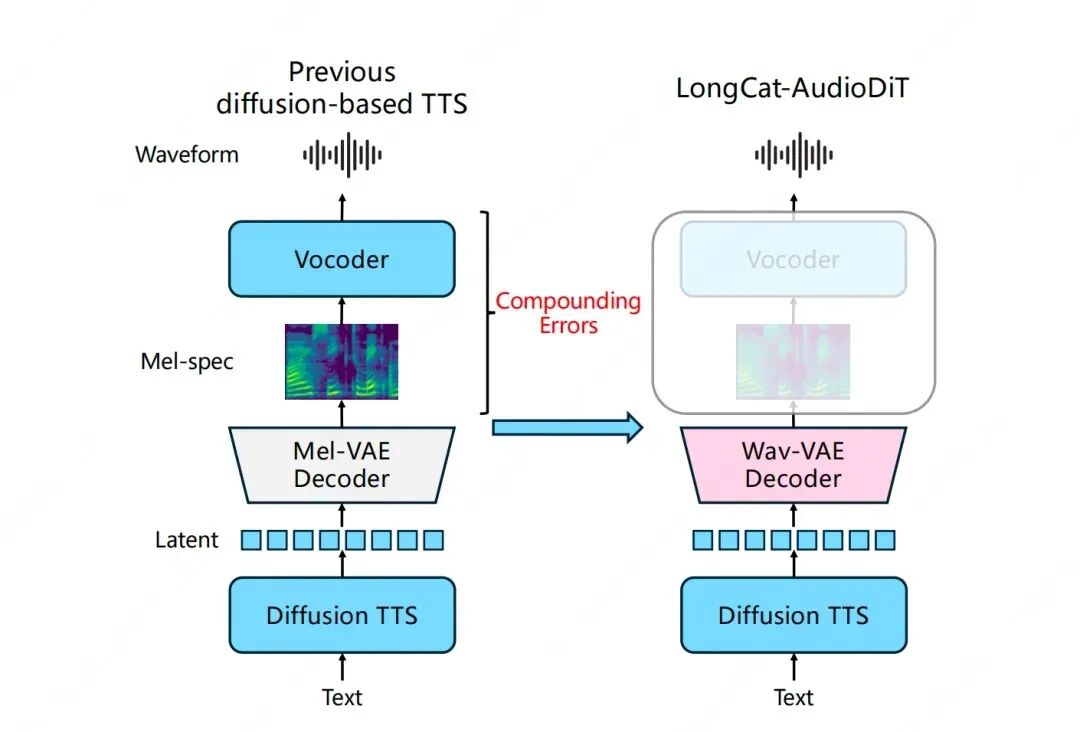

据介绍,LongCat-AudioDiT 直接在波形潜空间进行扩散建模,整个流程仅需一个波形变分自编码器(Wav-VAE)和一个扩散 Transformer(DiT),从根源上消除了多阶段级联带来的误差累积。

训练-推理对齐:在每步推理中将提示区域的隐变量强制重置为真值,解决长期存在的音色漂移问题。

自适应投影引导(APG):取代传统的无分类器引导(CFG),将引导信号分解为正交与平行分量,保留有益部分、抑制劣化部分,在提升音色相似度的同时避免频谱「过饱和」。

在 Seed 基准测试中,LongCat-AudioDiT-3.5B 的说话人相似度(SIM)在中文测试集(Seed-ZH)达到 0.818,中文难句集(Seed-Hard)达到 0.797,超越 Seed-TTS、CosyVoice3.5、MiniMax-Speech 等模型,取得当前最优(SOTA)成绩。

💻 GitHub: https://github.com/meituan-longcat/LongCat-AudioDiT

🤗 Hugging Face: https://huggingface.co/meituan-longcat/LongCat-AudioDiT