4 月 30 日消息,昨天,AI 研究员 Aran Komatsuzaki 公布了一项针对主流大模型分词工具(tokenizer)的横评结果,揭示了 Tokenizer 存在「语言歧视」:

非英语用户在使用同一模型时,实际消耗的 token 数远多于英语用户,相当于被悄悄征收了一笔「非英文税」。

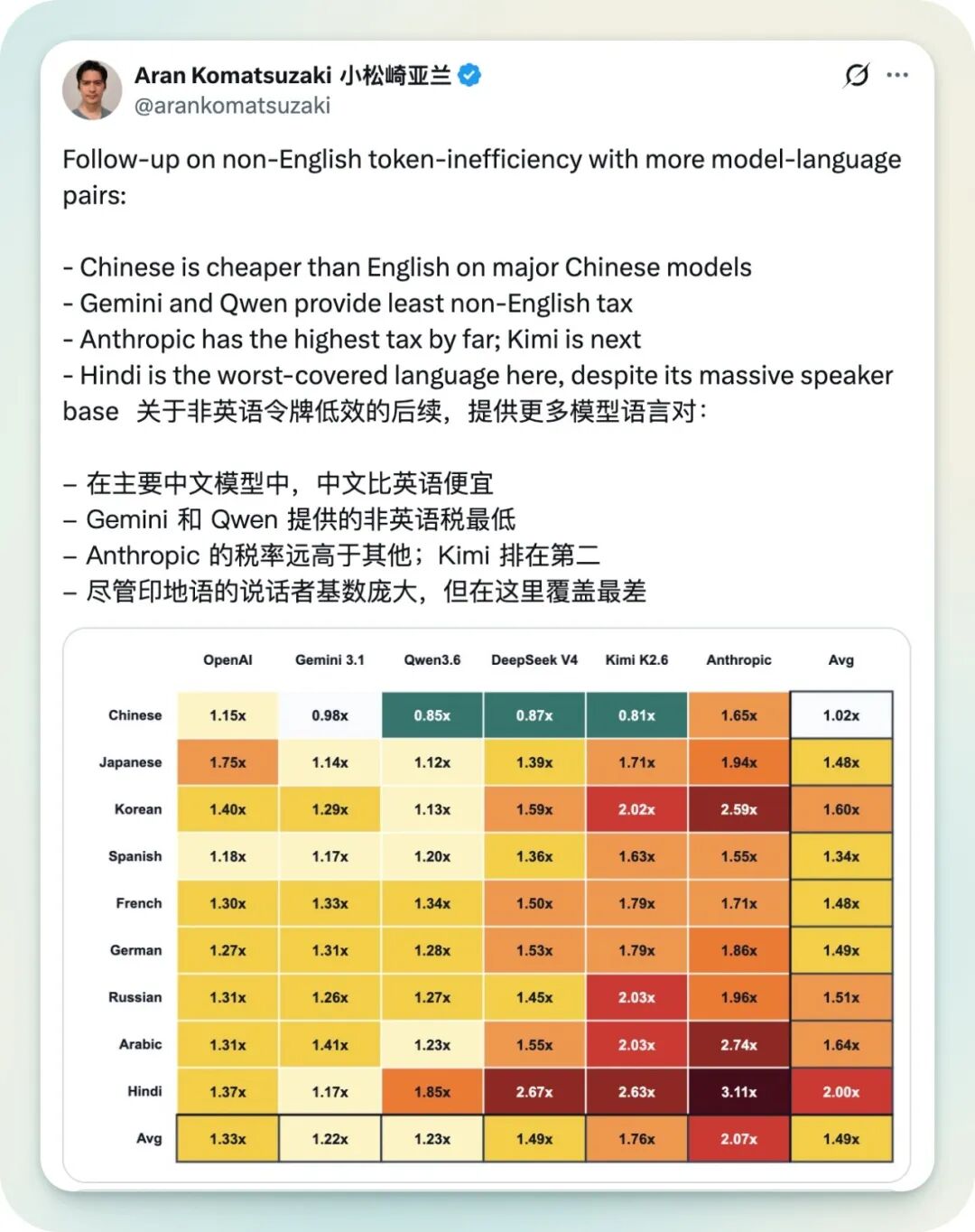

他将 Rich Sutton 的知名论文《The Bitter Lesson》翻译成 9 种语言,并分别喂入 6 家模型的 tokenizer,以英文原文在 OpenAI 分词工具上的 token 数为 1 倍基准,测量各语言在不同模型上的消耗倍数。

结果显示,同样的内容用中文提问,Claude 的 token 消耗达到基准的 1.71 倍,而 OpenAI 仅为 1.15 倍。印地语在 Claude 上的情况更为突出,token 消耗超过基准的 3.24 倍,阿拉伯语也达到 2.86 倍。

6 家模型横评中,Anthropic 的「非英文税」最高,Kimi 次之;Gemini 和 Qwen 的非英文税最低。Komatsuzaki 直言:「坦白说,我没想到 Claude 会差到这个程度,而且差距如此悬殊。我相信企业客户会非常在意这类问题。」

Komatsuzaki 指出,分词效率取决于模型训练数据中各语言的占比:英文数据量大,英文词汇被高效压缩;非英文数据较少,只能被切得更碎。

对用户而言,token 消耗增加意味着 API 调用成本直接上升,模型响应前的等待时间更长,上下文窗口也会更快耗尽。他的结论是:谁的市场大,谁的 token 就更省。