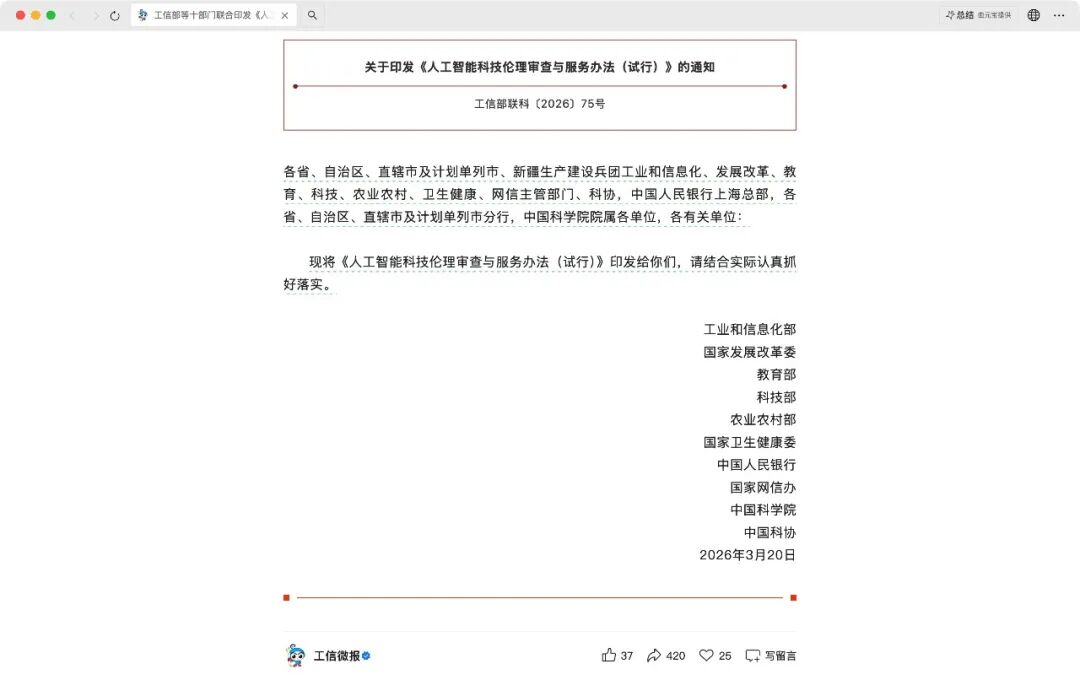

4 月 8 日消息,近日,工信部联合发改委、教育部、科技部等共十个部门,正式印发《人工智能科技伦理审查与服务办法(试行)》,为我国 AI 科技伦理审查与服务工作确立系统性制度框架。

《办法》覆盖境内可能带来伦理风险的 AI 科学研究与技术开发活动,要求将科技伦理要求贯穿全过程,遵循增进人类福祉、尊重生命权利、坚持公平公正、合理控制风险、保持公开透明、保护隐私安全、确保可控可信七项原则。

在审查机制上,《办法》设立四类程序:一般程序须在受理后 30 日内作出决定;应急程序适用于突发公共事件等紧急情形,须在 72 小时内完成。各单位须设立人工智能科技伦理委员会作为责任主体,未设立者可委托专业服务中心承接。

《办法》同步发布须经专家复核的高风险活动清单,涵盖三类:

对人类主观行为、心理情绪和生命健康具有较强影响的人机融合系统研发;

具有舆论社会动员能力和社会意识引导能力的算法模型、应用程序及系统研发;

面向安全、人身健康风险场景的高度自主自动化决策系统研发。