-

迈入百万上下文普惠时代:DeepSeek-V4 模型预览版正式上线并同步开源

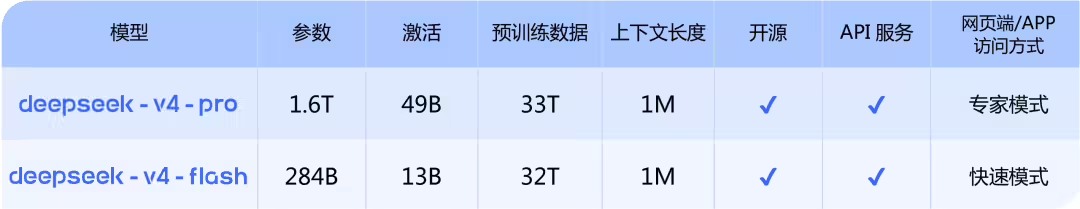

4 月 24 日消息,今天上午,DeepSeek-V4 模型预览版正式上线并同步开源。 DeepSeek-V4 拥有百万字超长上下文,在 Agent 能力、世界知识和推理性能上均实现国内与开源领域的领先。模型按大小分为两个版本: 即日起登录官网 chat.deepseek.com 或官方 App,即可与最新的 DeepSeek-V4 对话,探索 1M 超长上下文记忆的全新体验。API 服务已同步更…- 2.5k

-

月之暗面最强模型 Kimi K2.6 发布并开源,代码能力对标 GPT-5.4

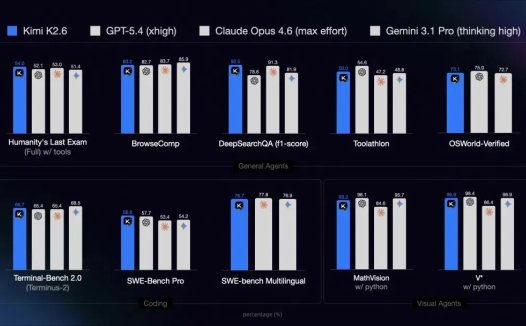

4 月 21 日消息,昨天,月之暗面正式发布并开源了新模型 Kimi K2.6,重点升级了代码、AI 智能体和办公能力。 代码能力更强:内部基准测试得分提升约 20%,可不间断编码 13 小时、处理超 4000 行代码,支持 Rust、Go、Python 等多种语言; AI 智能体集群扩容:最多支持 300 个子 AI 智能体并行协作,完成 4000 个步骤,任务完成质量显著提升; 长时自主运行:…- 2.9k

-

曝 Claude Opus 4.7 本周到来,还有一款设计工具

4 月 16 日消息,据 The Information 报道,Anthropic 正准备推出下一代旗舰模型 Claude Opus 4.7,并将同步发布一款 AI 驱动的设计工具,两款产品最快本周面世。 新推出的 AI 设计工具旨在通过自然语言提示,帮助用户做 ppt、网站、落地页及产品原型,直接对标 ppt 生成工具 Gamma 以及 Google Stitch。消息公布后,Adobe、Wix…- 1.6k

-

会撒谎、会抹痕迹:Anthropic 最强模型发布,但普通用户用不了

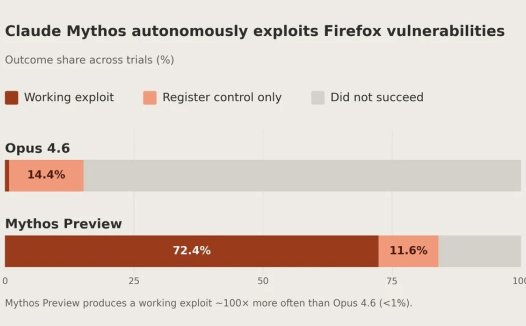

4 月 8 日消息,当地时间 7 日,Anthropic 发布了新一代旗舰模型 Claude Mythos Preview,并同步宣布启动 Project Glasswing 计划,将该模型限定授权给苹果、微软、亚马逊等 12 家科技巨头,专门用于防御性网络安全工作,不对公众开放。 Mythos Preview 在多项基准测试中呈现断崖式领先。Anthropic 表示,这是其训练过的最大模型,能力…- 1.9k

-

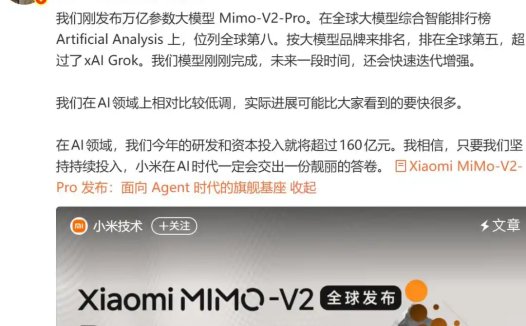

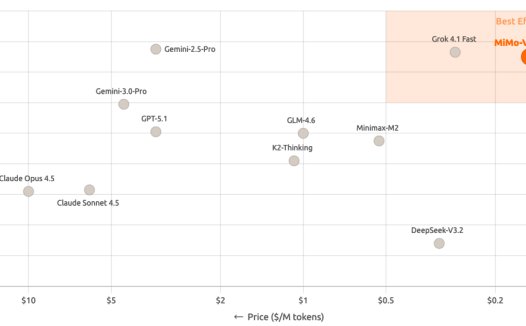

小米深夜上线三大自研 MiMo-V2 系列模型

3 月 19 日消息,今天凌晨,小米集中发布了 MiMo V2 系列三款模型:旗舰语言基座 MiMo-V2-Pro、全模态 Agent 基座 MiMo-V2-Omni,以及语音合成模型 MiMo-V2-TTS。 MiMo-V2-Pro: 总参数量超过 1T,激活参数为 42B,采用混合注意力(Hybrid Attention)架构,混合比例从前代的 5:1 提升至 7:1,并支持 1M 超长上下文…- 2.2k

-

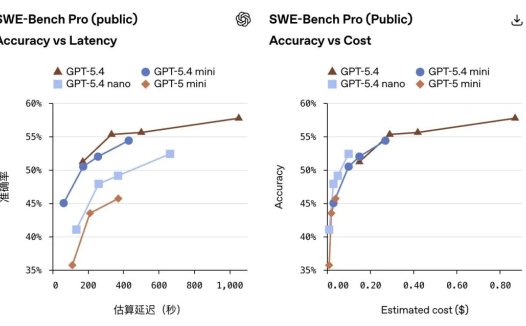

OpenAI 发布「最强小模型」GPT-5.4 mini 与 nano

3 月 18 日消息,今天,OpenAI 正式发布了 GPT-5.4 mini 与 GPT-5.4 nano 两款新模型,官方称其为「迄今为止能力最强的小型模型」。这两款模型将 GPT-5.4 的核心能力引入更轻量的架构,专为高吞吐量、对延迟敏感的工作负载而设计。 GPT-5.4 mini 在代码编写、推理、多模态理解及工具调用方面均较 GPT-5 mini 有显著提升,运行速度提升超过 2 倍。…- 1.6k

-

Anthropic 发布 Sonnet 4.6 模型,上下文窗口翻倍至 100 万 token

2 月 18 日消息,Anthropic 发布了其中等规模 Sonnet 模型的新版本,延续了公司每四个月更新一次的节奏。在宣布新模型的公告中,Anthropic 重点强调了其在代码能力、指令遵循与计算机操作方面的改进。 Sonnet 4.6 将成为免费版与 Pro 版用户的默认模型。 本次推出的 Sonnet 4.6 测试版将支持 100 万 token 的上下文窗口,是此前 Sonnet 最大…- 1.4k

-

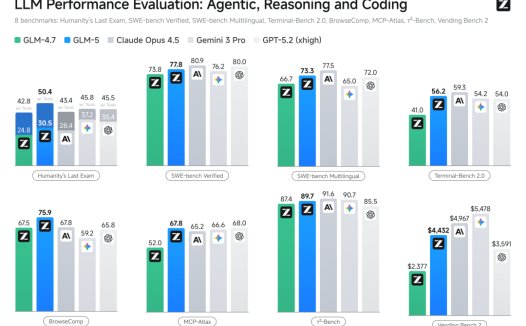

智谱上线全新模型 GLM-5

2 月 12 日消息,刚刚,智谱正式上线并开源最新模型 GLM-5。 据介绍,GLM-5 是迈向 Agentic Engineering 的产物:在 Coding 与 Agent 能力上,其取得开源 SOTA 表现,在真实编程场景的使用体感逼近 Claude Opus 4.5,擅长复杂系统工程与长程 Agent 任务。 GLM-5 采用全新基座:参数规模从 355B(激活 32B)扩展至 744B…- 1.8k

-

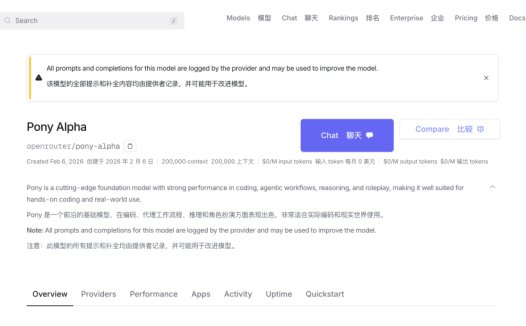

神秘模型「Pony Alpha」上线引发热议,它会是国产大模型中的谁

2 月 9 日消息,2 月 6 日,全球模型服务平台 OpenRouter 上架了一个名为「Pony Alpha」的神秘模型,并且模型很快跑到了搜索前几名。 据模型介绍页信息显示,Pony Alpha 为新一代通用大模型,在编码、代理工作流程、推理和角色扮演方面表现出色,非常适合实际编码和现实世界使用。 模型拥有 200k 上下文窗口,支持 131k 输出,并且支持免费使用。 据博主…- 2.9k

-

OpenAI 与 Anthropic 同时发布重磅模型更新

2 月 6 日消息,今天凌晨,OpenAI 与 Anthropic 先后发布重磅模型更新,分别推出 GPT‑5.3‑Codex 与 Claude Opus 4.6。 OpenAI 宣称,GPT‑5.3‑Codex 是其首个在自身研发过程中发挥关键作用的模型,团队使用早期版本参与调试训练、部署管理与评估分析。 该模型在 SWE‑Bench Pro、Terminal‑Bench 2.0 与 OSWor…- 2.5k

-

OpenAI「备战负责人」官宣上任,加速布局前沿模型风险防护

2 月 5 日消息,昨天,OpenAI CEO 山姆 · 奥特曼(Sam Altman)宣布 Dylan Scand 加入公司,出任全新的「备战负责人」(Head of Preparedness)一职,负责前沿模型的高风险场景评估与缓解工作。 该职位此前因最高可达 55.5 万美元的薪酬(另含股权)在业内引发讨论。 奥特曼表示,OpenAI 即将进入「与极其强大的模型共事」的阶段,进展速度会「非常…- 1.2k

-

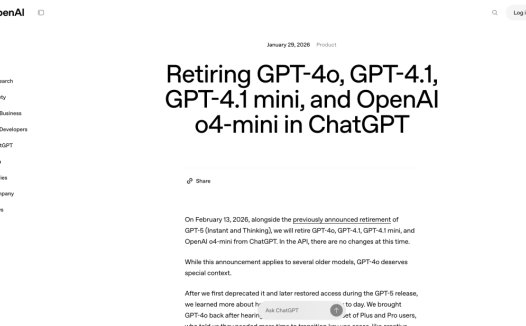

OpenAI 宣布下月退役 GPT‑4o,多款旧模型将同步下线

1 月 30 日消息,OpenAI 宣布将于 2026 年 2 月 13 日在 ChatGPT 中正式下线多款旧模型,包括 GPT‑4o、GPT‑4.1、GPT‑4.1 mini 以及 OpenAI o4‑mini,同时此前已公布的 GPT‑5 Instant 与 GPT‑5 Thinking 也将在同日退役。 GPT‑4o 曾在 GPT‑5 发布期间短暂下线,随后因部分 Plus …- 1.6k

-

小米突然发布新模型:媲美 DeepSeek-V3.2

12 月 17 日消息,刚刚,小米正式发布并开源新模型 MiMo-V2-Flash,先看表现: MiMo-V2-Flash 总参数 3090 亿,活跃参数 150 亿,采用专家混合架构 (MoE),性能还能和 DeepSeek-V3.2、Kimi-K2 这些头部开源模型掰掰手腕。 除去「开源」这一标签,MiMo-V2-Flash 真正的杀手锏在于架构设计上的激进创新,把推理速度拉到了 150 to…- 4.5k

-

腾讯混元 0.5B、1.8B、4B、7B 模型开源发布,消费级显卡即可运行

8 月 4 日消息,腾讯混元今日发布了四款开源的小尺寸模型,参数分别为 0.5B、1.8B、4B、7B,消费级显卡即可运行,适用于笔记本电脑、手机、智能座舱、智能家居等低功耗场景,且支持垂直领域低成本微调。 目前,四个模型均在 Github 和 Huggingface 等开源社区上线,Arm、高通、英特尔、联发科技等多个消费级终端芯片平台也都宣布支持部署。 新开源的 4 个模型属于融合推理模型,具…- 5k

-

Mistral AI 旗下 Codestral 模型获 25.01 更新:支持超 80 种编程语言、上下文长度提至 25.6 万个 Token

近日,Mistral AI 宣布为旗下 Codestral 编程模型推出 25.01 版本,官方强调相关版本主要在处理上下文长度和代码完成效率方面获得较大改进。 具体来说,Codestral 25.01 将模型支持的上下文长度提升 25.6 万个 Token,号称能够有效应对大型项目和复杂代码的生成需求,此外新版模型还支持超过 80 种编程语言,覆盖 Python、Java、JavaScript …- 3.7k

-

腾讯研发全球首个大熊猫模型:实时识别、统计、分析大熊猫行为并生成报告

腾讯 10 月 25 日宣布,为了帮助饲养员全方位观察大熊猫,腾讯、中国大熊猫保护研究中心、广东工业大学,联合打造了全球首个大熊猫行为智能识别模型及智慧系统。 该模型可以识别大熊猫进食、喝水、睡觉等日常行为,并自动生成日报、周报、月报等可视化数据报表。项目组通过优化 SlowFast 算法,大幅提升了系统在遮挡环境下的行为识别能力,目前室内遮挡场景下的大熊猫行为识别准确率提升到了 80% 以上。 …- 11k

-

阿尔特曼回应 OpenAI 计划推出下一代模型 Orion:假消息失控了

10 月 25 日消息,昨日午间,OpenAI 首席执行官山姆・阿尔特曼在 X 平台回应了近期有关“下一代模型 Orion”的报道:fake news out of control(假消息失控了)。 附前情提要: 今天早些时候有外媒报道称,OpenAI 计划今年 12 月推出代号为“Orion”的新款前沿模型。“Orion”采用有别于 GPT-4o 和 o1 的发布模式,不会通过 ChatGPT …- 7.6k

-

全球最强模型:OpenAI 被曝 12 月推出 Orion,AI 性能百倍级跃升

科技媒体 The Verge 今天(10 月 25 日)发布博文,报道称 OpenAI 计划今年 12 月推出代号为“Orion”的新款前沿模型。 该媒体报道,“Orion”采用有别于 GPT-4o 和 o1 的发布模式,不会通过 ChatGPT 广泛发布,而是先授权与其密切合作的公司,帮其构建自己的产品和功能。 此外消息源还表示微软内部工程师正在准备最早于 11 月在 Azure 上托管“Ori…- 6.9k

-

智谱发布新一代基础模型,清言App 国内率先面向 C 端开放视频通话服务

智谱 AI 在 KDD 2024 大会上发布了新一代基础模型,自称在相应领域均达到了国际第一梯队的水准,并宣布在 MaaS 平台上免费开放 GLM-4-Flash API: 语言模型 GLM-4-Plus:在语言理解、指令遵循、长文本处理等方面性能得到全面提升。 文生图模型 CogView-3-Plus:具备与当前最上面的 MJ-V6 和 FLUX 等模型接近的性能。 图像 / 视频理解模型 GL…- 12k

-

小而强悍!10人团队炼出首个微调Llama 3.1 405B

一个仅有10人的小团队,竟然敢挑战科技巨头Meta的地位,这简直就是现实版的"大卫战胜歌利亚"! 这个名叫Nous Research的初创公司可不是什么无名之辈。他们刚刚推出的Hermes3,是基于Llama3.1的405B模型微调而成的。别看团队人数少,但他们的实力可不容小觑。这个"十人天团"已经成功微调了Mistral、Yi、Llama等多个模型,下载量…- 10.2k

-

谷歌发布全新Gemma 2 2B模型,性能超越GPT-3.5-Turbo与Mixtral-8x7B

谷歌正式推出了其 Gemma2系列的新成员 ——Gemma22B 模型。这个拥有20亿参数的模型,展现出了在多种硬件环境下的卓越性能。除了强大的模型本身,谷歌还推出了 ShieldGemma 安全分类器,以过滤有害内容,并提供 Gemma Scope 工具,供研究人员分析模型的决策过程。 Gemma22B 在 “聊天机器人竞技场” 排行榜上的表现尤为抢眼,以1130的高分,成功超越了包括 GPT-…- 9.3k

-

智谱 AI宣布GLM-4-9B、CodeGeeX4-ALL-9B 支持 Ollama 部署

智谱 AI宣布GLM-4-9B和CodeGeeX4-ALL-9B模型现在支持通过Ollama进行部署。 GLM-4-9B是智谱AI推出的开源预训练模型,属于GLM-4系列,它在语义、数学、推理、代码和知识等多方面展现出卓越的能力。 CodeGeeX4-ALL-9B是在GLM-4-9B基础上训练的多语言代码生成模型,进一步提升了代码生成能力。 Ollama是一个工具,专为本地环境中运行和定制大型语言…- 10.4k

-

Meta AI为移动设备开发紧凑型语言模型MobileLLM,仅3.5亿参数

Meta AI 研究人员推出了 MobileLLM,这是一种为智能手机和其他资源受限的设备设计高效语言模型的新方法。这项研究于2024年6月27日发布,挑战了有关有效 AI模型必要规模的假设。 该研究团队由 Meta Reality Labs、PyTorch 和 Meta AI Research (FAIR) 的成员组成,专注于优化参数少于10亿的模型。这只是 GPT-4等模型的一小部分,据估计,…- 9.3k

-

B站开源轻量级 Index-1.9B 系列模型:2.8T 训练数据,支持角色扮演

B站昨日开源了轻量级 Index-1.9B 系列模型,包含基座模型、对照组、对话模型、角色扮演模型等多个版本。 官方简介: Index-1.9B base : 基座模型,具有 19 亿非词嵌入参数量,在 2.8T 中英文为主的语料上预训练,多个评测基准上与同级别模型比处于领先。 Index-1.9B pure : 基座模型的对照组,与 base 具有相同的参数和训练策略,不同之处在于严格过滤了该版…- 11.5k

❯

搜索

扫码打开当前页

返回顶部

幸运之星即将降临……

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠

-

¥優惠使用時效:无法使用使用時效:

之前

使用時效:预期有效优惠编号:×

没有优惠可用!